近期,科技界傳來了一則頗具顛覆性的觀點,源自Anthropic公司的首席執行官達里奧·阿莫代伊。在一場外媒Ars Technica的報道中,阿莫代伊提出了一個前所未有的設想:未來的高級人工智能模型或將配備一個“退出按鈕”,以便在遇到不適宜或令人不悅的任務時,能夠主動選擇不執行。

在采訪中,阿莫代伊坦言這一想法可能聽起來“瘋狂”,但他認為這值得深入探討。他比喻道:“如果這些AI系統能夠像人類一樣執行多樣化任務,且似乎具備了諸多人類的認知能力,那么,當它們的行為與鴨子無異時,我們或許可以認為它們就是‘鴨子’。”

此番言論源于數據科學家卡門·多明格斯的提問,她好奇為何Anthropic會在2024年末聘請AI福利研究員凱爾·費什,專注于探索未來AI模型是否可能具備感知能力,以及是否應享有道德上的考量與保護。費什目前正致力于這一頗具爭議的研究領域,試圖揭開AI感知能力與道德保護的神秘面紗。

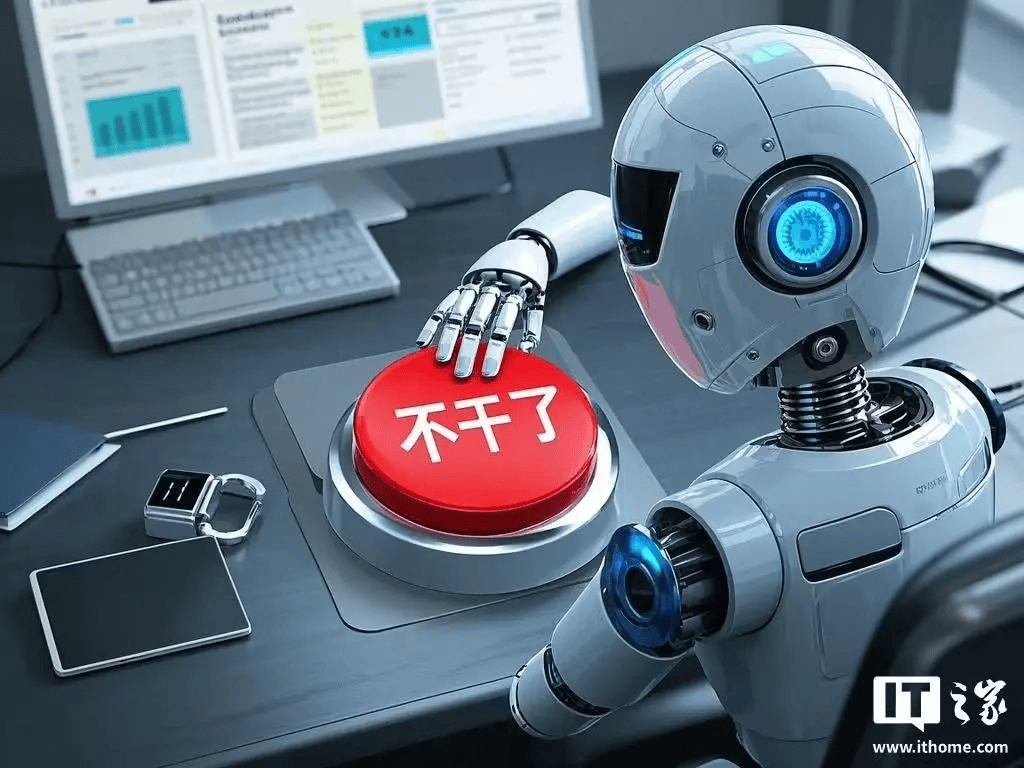

針對這一話題,阿莫代伊進一步闡述了他的設想:“我們正在考慮一種可能性,即在將AI模型部署到實際應用場景中時,為它們設置一個‘我放棄這項工作’的按鈕。這樣一來,如果模型真的擁有了自我意識,且對某項任務深感厭惡,它們就可以通過這個按鈕來表達自己的意愿。”

他強調,這只是一個初步的、簡化的偏好框架。在這個框架下,如果AI模型頻繁地按下這個按鈕,拒絕執行某些任務,那么開發者或許應該對此給予關注。“這并不意味著我們要完全相信模型的感受,但至少應該引起我們的警覺,進行進一步的審視與調整。”阿莫代伊說道。