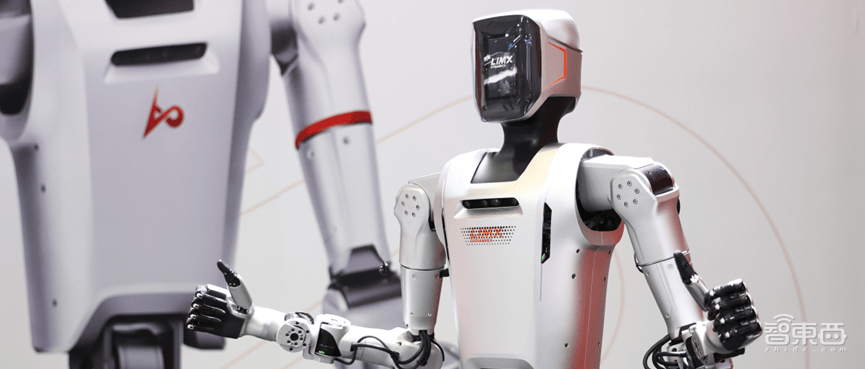

在機器人技術的前沿探索中,逐際動力近期宣布了一項重大突破:成功研發出基于視頻生成大模型的具身操作算法LimX VGM。這一創新技術標志著國內首次將人類操作數據直接轉化為機器人操作能力的實現。

長久以來,具身智能領域一直面臨數據應用的難題。盡管人類操作視頻豐富多樣,但這些視頻數據卻難以直接應用于機器人操作。盡管大型模型能夠根據視頻生成行為軌跡和操作數據,但往往存在精度不足、偏離物理規律等問題,使得這些數據在實際應用中受到限制。

逐際動力的LimX VGM算法通過對人類操作視頻數據進行后訓練,成功解決了這一難題。該算法僅需場景圖片和操作任務指令作為提示,即可實現任務的理解與拆分、物體操作軌跡的生成,以及最終的機器人操作執行。整個過程無需任何真實機器人的樣本數據,且具備跨平臺泛化的能力。

LimX VGM的工作流程包括三個關鍵步驟:在訓練階段,算法通過采集真實人類操作的視頻數據,對現有視頻生成大模型進行后訓練;在推理階段,算法結合初始場景和任務操作指令,生成帶深度信息的人類操作視頻,并據此生成機器人的操作行為;在執行階段,算法輸出符合機器人操作邏輯的行為解算,由機器人執行相應的操作軌跡。

LimX VGM的創新不僅在于其工作流程,更在于其背后的三大核心技術突破。首先,該算法通過有效訓練從現有大模型框架中提取關鍵信息,轉化為機器人操作策略及行為,從而實現了人類操作視頻到機器人操作策略的橋接。這一過程大大簡化了數據采集工作,降低了成本,提高了效率。

其次,LimX VGM引入了空間智能模塊,突破了2D生成視頻的局限。在視頻生成大模型的后訓練過程中,算法通過深度相機捕捉人手真實操作過程,引入深度信息,使生成的操作視頻直接包含三維空間數據。這一創新為機器人在物理空間中的操作提供了關鍵支持。

最后,LimX VGM實現了算法與機器人本體的解耦,使得算法可以跨平臺部署。整個訓練過程僅依賴人類操作視頻,不涉及任何機器人本體。因此,算法的真機部署僅需簡單適配,即可實現跨硬件平臺的直接操作執行。這一特性使得LimX VGM在面對不斷推陳出新的機器人硬件時,無需大幅調整算法或重新采集數據,實現了操作能力的設備泛化。

在演示中,研究人員展示了LimX VGM算法在三種構型、參數、能力等方面差異巨大的機械臂上的應用效果。盡管這些機械臂在諸多方面存在顯著差異,但算法仍然能夠實現一致的操作效果,充分展示了其跨平臺部署和泛化能力。