在設計集成電路時,工程師的目標是生產(chǎn)出更容易制造的高效設計。如果他們設法降低電路尺寸,那么制造該電路的經(jīng)濟性也會下降。英偉達公司在其技術博客上發(fā)布了一項技術,該公司使用一種名為PrefixRL的人工智能模型。利用深度強化學習,英偉達公司使用PrefixRL模型來超越主要供應商的傳統(tǒng)EDA(電子設計自動化)工具,如Cadence、Synopsys或Siemens/Mentor。

EDA供應商通常會在內(nèi)部實施人工智能解決方案,以實現(xiàn)硅片放置和路由(PnR);然而,英偉達的PrefixRL解決方案似乎在該公司的工作流程中創(chuàng)造了奇跡。

創(chuàng)建一個深度強化學習模型,旨在保持與EDA PnR嘗試相同的延遲,同時實現(xiàn)更小的芯片面積,這是PrefixRL的目標。

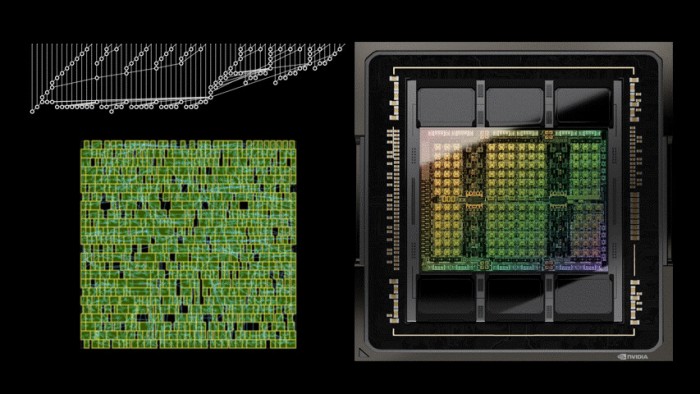

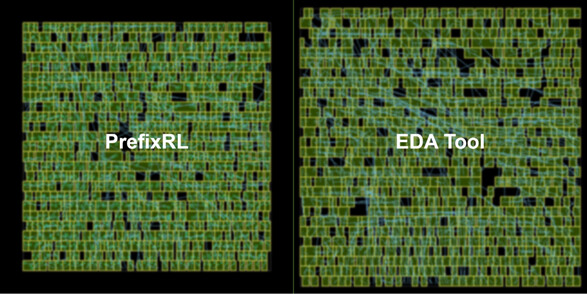

根據(jù)NVIDIA技術博客介紹,最新的Hopper H100 GPU架構使用了PrefixRL AI模型設計的13000個算術電路實例。英偉達制作的模型輸出的電路比同類EDA輸出的電路小25%。這一切都在實現(xiàn)類似或更好的延遲。下面你可以在圖中比較PrefixRL制作的64位加法器設計和一個業(yè)界領先的EDA工具制作的相同設計:

訓練這樣一個模型是一項計算密集型的任務。英偉達公司報告說,設計一個64位加法器電路的訓練,每個GPU需要256個CPU核心和32000個GPU小時。該公司開發(fā)了Raptor,這是一個內(nèi)部分布式強化學習平臺,利用英偉達硬件的獨特優(yōu)勢進行這種工業(yè)強化學習,你可以看到下面的內(nèi)容以及它的操作方式:

總的來說,該系統(tǒng)相當復雜,需要大量的硬件和投入;然而,回報是更小、更高效的GPU。