興坤 發(fā)自 凹非寺

量子位 報(bào)道 | 公眾號 QbitAI

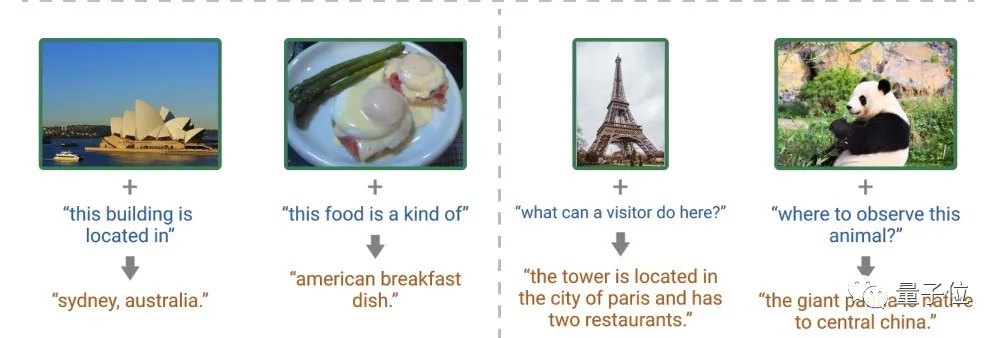

谷歌新推出了弱監(jiān)督看圖說話模型SimVLM,能夠輕松實(shí)現(xiàn)零樣本學(xué)習(xí)(zero-shot)任務(wù)遷移。

從文字描述圖像到回答圖片相關(guān)問題,模型無需微調(diào)也能樣樣精通。

對于一般的視覺語言預(yù)訓(xùn)練(VLP)模型,訓(xùn)練數(shù)據(jù)集中要求包含大量精準(zhǔn)標(biāo)簽。而模型的任務(wù)遷移,則需要針對特定任務(wù)重新進(jìn)行數(shù)據(jù)集的標(biāo)簽標(biāo)注。

總結(jié)下來,就是標(biāo)注數(shù)據(jù)集不僅耗時(shí)耗力,還不能多任務(wù)通用。

能不能開發(fā)出一種又簡單又萬能的VLP模型呢?

谷歌新開發(fā)的這款模型使用了弱監(jiān)督學(xué)習(xí)進(jìn)行模型訓(xùn)練,通過利用大量的弱對齊圖像-文本對進(jìn)行建模,簡化了VLP的訓(xùn)練流程,大大降低了訓(xùn)練的復(fù)雜性。

SimVLM使用前綴語言建模的單一目標(biāo)進(jìn)行端到端訓(xùn)練,并直接將原始圖像作為輸入。這些設(shè)置允許模型對大規(guī)模的弱標(biāo)記數(shù)據(jù)集進(jìn)行利用,從而能夠更好地實(shí)現(xiàn)零樣本學(xué)習(xí)泛化效果。

SimVLM模型是如何實(shí)現(xiàn)的?

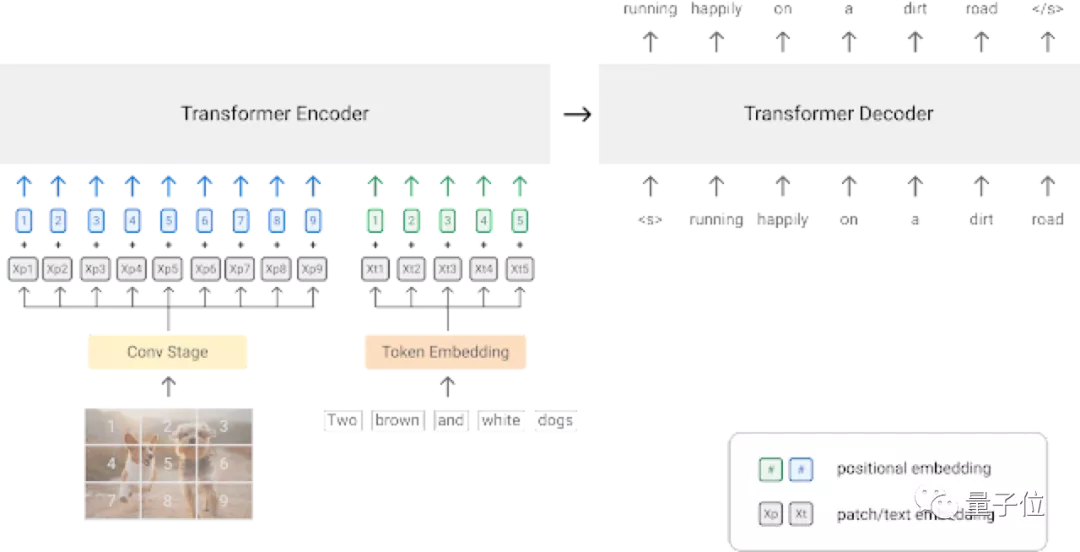

SimVLM模型的預(yù)訓(xùn)練過程采用了前綴語言建模(PrefixLM)的單一目標(biāo),接受序列的前綴作為輸入,通過模型解碼器來預(yù)測其延續(xù)的內(nèi)容。

對于數(shù)據(jù)集中的圖像-文本對,圖像序列可視作其文本描述的前綴。

這種方法可以簡化訓(xùn)練過程,最大限度地提高模型在適應(yīng)不同任務(wù)設(shè)置方面的靈活性和通用性。

模型的主干網(wǎng)絡(luò),則使用了在語言和視覺任務(wù)上均表現(xiàn)突出的Transformer架構(gòu)。

對輸入的原始圖像數(shù)據(jù)提取上下文patch,這里采用了ResNet卷積網(wǎng)絡(luò)。

如上圖所示:視覺模態(tài)中,圖片被分割成多個(gè)patch,然后壓縮為一維序列。文本模態(tài)語句則被映射到了一個(gè)表征向量中。

本模型使用了包含大約1.8B噪聲的圖像-文本對ALIGN訓(xùn)練集進(jìn)行預(yù)訓(xùn)練,以此來實(shí)現(xiàn)更好的零樣本學(xué)習(xí)泛化能力。

為了補(bǔ)償訓(xùn)練集中的噪聲影響,訓(xùn)練模型另外還使用了共800G的Colossal Clean Crawled Corpus (C4)數(shù)據(jù)集。

SimVLM模型基礎(chǔ)性能如何?

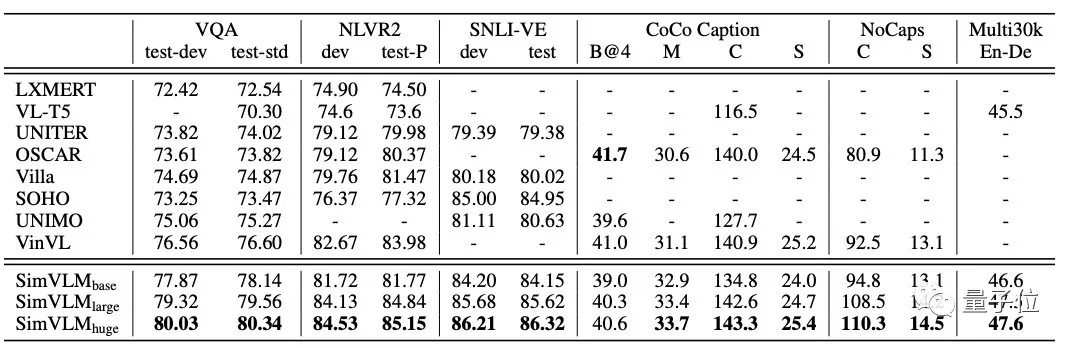

模型的預(yù)訓(xùn)練完成后,需要在多模式任務(wù)中對模型進(jìn)行微調(diào),以測試性能。

這里用到的多模式任務(wù)有:VQA、NLVR2、SNLI-VE、COCO Caption、NoCaps和Multi30K En-De。

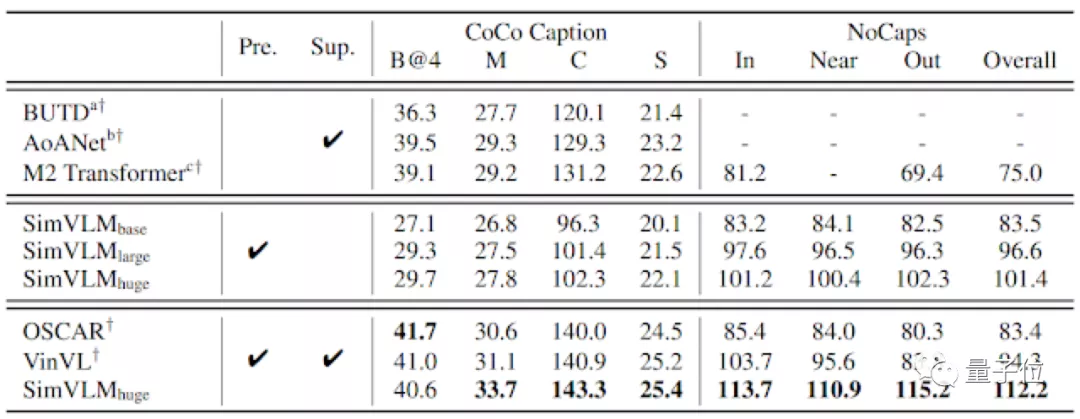

將SimVLM模型與現(xiàn)有的功能完善的模型進(jìn)行比較,測試結(jié)果如上表所示,參與評估的SimVLM模型還包括了三種不同規(guī)模:8600萬參數(shù)、3.07億參數(shù)和6.32億參數(shù)。

跨模式任務(wù)的測試結(jié)果中,SimVLM模型的性能表現(xiàn)最好(數(shù)據(jù)越大越好),除了CoCo Caption的B@4指標(biāo),在其他任務(wù)上都取得了新的SOTA結(jié)果,充分證明了該模型的先進(jìn)性。

SimVLM模型零樣本泛化

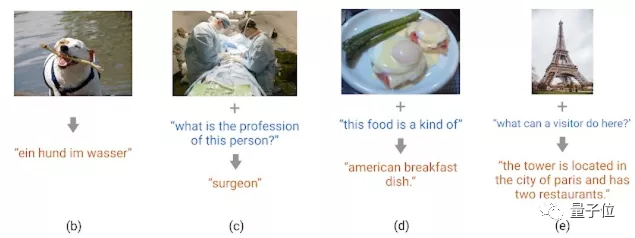

SimVLM模型在跨模式任務(wù)測試中可以取得不錯(cuò)的性能表現(xiàn),那么它能否順利執(zhí)行零樣本跨模態(tài)轉(zhuǎn)移呢?

預(yù)訓(xùn)練的SimVLM模型僅對文本數(shù)據(jù)進(jìn)行微調(diào)或完全不進(jìn)行微調(diào),通過圖像字幕、多語言字幕、開放式VQA和視覺文本生成等任務(wù),對模型進(jìn)行測試。

測試結(jié)果如下圖所示:

給定圖像和文本提示,預(yù)訓(xùn)練模型無需微調(diào)即可預(yù)測圖像的內(nèi)容。

除此之外,未進(jìn)行過微調(diào)的模型在德語字幕生成、數(shù)據(jù)集外的答案生成、基于圖像內(nèi)容的文字描述、開放式視覺問題回答等應(yīng)用上均有不錯(cuò)的表現(xiàn)。

為了量化SimVLM的零樣本學(xué)習(xí)性能,這里采用了預(yù)訓(xùn)練的固化模型在COCO Caption和NoCaps上進(jìn)行解碼,然后與監(jiān)督標(biāo)準(zhǔn)基線(Sup.)進(jìn)行比較。

從結(jié)果對比上來看,即使沒有監(jiān)督微調(diào),SimVLM也可以達(dá)到有監(jiān)督的訓(xùn)練質(zhì)量水平。

作者介紹

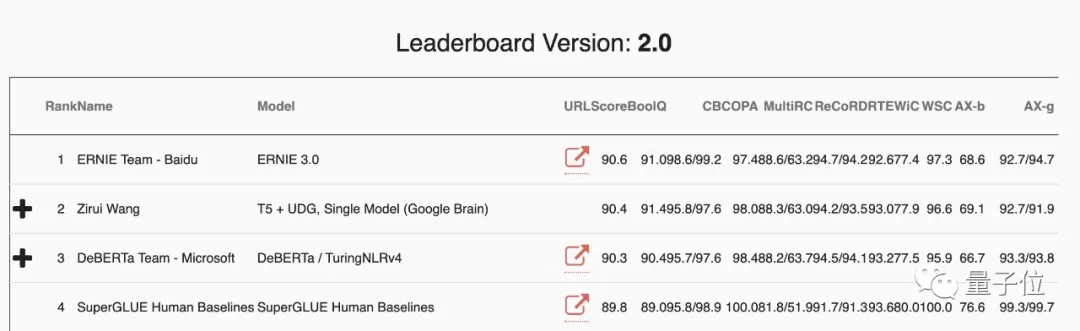

本研究的第一作者是谷歌學(xué)生研究員王子瑞,現(xiàn)就讀于卡內(nèi)基梅隆大學(xué),曾以第一作者身份在ICLR、EMNLP、CVPR等頂會(huì)上發(fā)表了多篇論文。

截止到2020年12月20日,他在SuperGLUE數(shù)據(jù)集上獲得了第一個(gè)超過人類得分的SOTA性能(分?jǐn)?shù)超過90),目前則被百度團(tuán)隊(duì)趕超,位居第二。

這一次開發(fā)的SimVLM也在6個(gè)視覺語言基準(zhǔn)測試中達(dá)到了單模型SOTA性能,并實(shí)現(xiàn)了基于文本引導(dǎo)的零樣本學(xué)習(xí)泛化能力。

參考鏈接:

https://arxiv.org/abs/2108.10904

https://ai.googleblog.com/2021/10/simvlm-simple-visual-language-model-pre.html

http://www.cs.cmu.edu/~ziruiw/

— 完 —

量子位 QbitAI · 頭條號簽約

關(guān)注我們,第一時(shí)間獲知前沿科技動(dòng)態(tài)