衡宇 金磊 發(fā)自 凹非寺

量子位 | 公眾號 QbitAI

就在剛剛,王小川的開源大模型又有了新動作——

百川智能,正式發(fā)布130億參數(shù)通用大語言模型(Baichuan-13B-Base)。

并且官方對此的評價是:

性能最強的中英文百億參數(shù)量開源模型。

與此一同出道的,還有一個對話模型Baichuan-13B-Chat,以及它的INT4/INT8兩個量化版本。

但更重要的一點是(劃重點),完全開源!免費可商用!

就在不久前的6月15日,百川智能才剛剛發(fā)布其第一款70億參數(shù)量的中英文語言模型Baichuan-7B。

當(dāng)時的版本便已經(jīng)拿下多個世界權(quán)威Benchmark榜單同量級測試榜首;同樣作為開源大模型,據(jù)說清華北大都已經(jīng)用上了。

僅僅時隔25天,更大、更強的版本再次襲來,不得不說,王小川在技術(shù)上的動作是有夠緊鑼密鼓的了。

那么這次號稱的“最強開源大模型”,具體表現(xiàn)又是怎樣呢?

多領(lǐng)域超越ChatGPT

老規(guī)矩,先提綱挈領(lǐng)地說一下Baichuan-13B的基本個“模”資料:

中英雙語大模型,130億參數(shù),在1.4萬億token數(shù)據(jù)集上訓(xùn)練,完全開源、免費可商用。

1.4萬億ztoken這個訓(xùn)練數(shù)據(jù)量,超過LLaMA-13B訓(xùn)練數(shù)據(jù)量的40%,是當(dāng)前開源的13B尺寸模型世界里,訓(xùn)練數(shù)據(jù)量最大的模型。

此外,Baichuan-13B上下文窗口長度為4096——這就不得不提到其與7B版本完全不同的編碼方式。

7B版本采用RoPE編碼方式,而13B使用了ALiBi位置編碼技術(shù),后者能夠處理長上下文窗口,甚至可以推斷超出訓(xùn)練期間讀取數(shù)據(jù)的上下文長度,從而更好地捕捉文本中上下文的相關(guān)性,讓預(yù)測或生成更準(zhǔn)確。

作為一款中英文雙語大模型,Baichuan-13B采用了相對平衡的中英文語料配比和多語言對齊語料,從而在中英兩種語言上都有不俗表現(xiàn)。

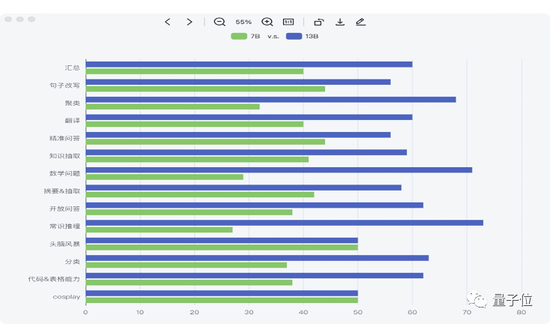

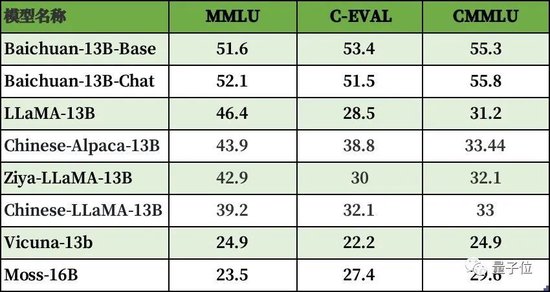

主流百億參數(shù)13B開源模型benchmark成績

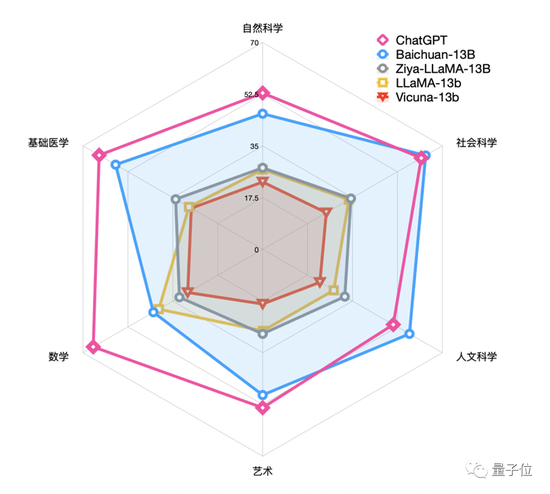

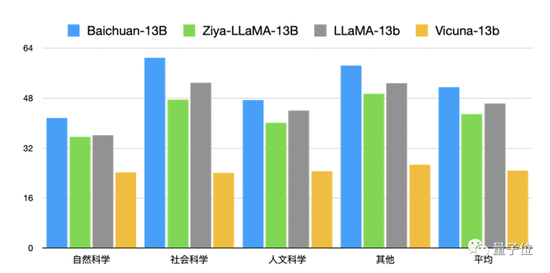

來看看Baichuan-13B在中文領(lǐng)域的測評成績。

在評測集C-EVAl上,Baichuan-13B在自然科學(xué)、醫(yī)學(xué)、藝術(shù)、數(shù)學(xué)等領(lǐng)域領(lǐng)先LLaMA-13B、Vicuna-13B等同尺寸的大語言模型。

社會科學(xué)和人文科學(xué)領(lǐng)域,水平比ChatGPT還要好上一點。

英文領(lǐng)域的表現(xiàn)也算不錯,能比同尺寸的其他開源模型,如LLaMA-13B、Vicuna-13B都有更好的表現(xiàn)。

通常而言,非專業(yè)用戶和有具體需求的企業(yè),對有對話功能的對齊模型有更重的好奇心。

鑒于這個情況,百川智能此次在發(fā)布與訓(xùn)練模型底座Baichuan-13B-Base的同時,還發(fā)布了其對話模型Baichuan-13B-Chat及其INT4/INT8兩個量化版本。

來看看對話模型的實際表現(xiàn)效果——

讓它寫個商品介紹郵件,它能寫出醬嬸兒的:

數(shù)據(jù)推理能力如何?

也淺測了一番:

至于互聯(lián)網(wǎng)上遠(yuǎn)古或新近流行的各種梗,Baichuan-13B-Chat好像也沒在怕的:

官方介紹,為了保證模型的純凈度,Baichuan-13B-Base和Baichuan-13B-Chat沒有針對任何benchmark測試進(jìn)行專項優(yōu)化,具有更高的效能和可定制性。

為什么要完全開源、可商用?

正如我們剛才提到的,這次百川智能推出的Baichuan-13B-Base是對學(xué)術(shù)研究完全開放。

不僅如此,所有開發(fā)者均可通過郵件向百川智能申請授權(quán),在獲得官方商用許可后即可免費商用。

而且據(jù)官方的說法,百川智能是為了降低使用的門檻,才同時開源了Baichuan-13B-Chat的INT8和INT4兩個量化版本。

這樣一來,在近乎無損的情況下,便可以將模型部署在如3090等消費級顯卡上。

想必很多小伙伴就要問了,百川智能為什么要走這么一條路?

其實如果看下Meta在大模型上的開源之路,便可窺知一二。

我們都知道大模型在訓(xùn)練的成本極高,因此像OpenAI和谷歌兩大科技巨頭最初選擇的是閉源的“路數(shù)”,它們?yōu)榈木褪且源吮WC自己的優(yōu)勢。

而Meta后來所推出的LLaMa則與之“背道而馳”,但所迸發(fā)出來的潛力卻是有目共睹——

迅速吸引大批開發(fā)者,在LLaMa基礎(chǔ)上迭代出了各種ChatGPT的替代品,甚至在性能的表現(xiàn)上是可以匹敵GPT-3.5的那種。

加之業(yè)界對大模型未來發(fā)展態(tài)勢已經(jīng)達(dá)成了一個共識:

類似Android/ target=_blank class=infotextkey>安卓和IOS,將會是開源和閉源共存的狀態(tài)。

因此,開源在大模型的發(fā)展中已然成為一股不可或缺的中堅力量。

……

那么你對于王小川的新大模型,有何看法呢?