沒(méi)想到,擁有“AI”后的世界已經(jīng)發(fā)展成這樣了!

自從去年ChatGPT面世后,今年5月谷歌也坐不住了,宣布要搞AI大模型,但由于種種原因,一直等到大半年后的今天,才正式發(fā)布了新一代大語(yǔ)言模型“Gemini”。

谷歌出手,就是不同凡響,雖然步子慢了,但成果很“硬核”。在官方演示中,Gemini可以非常自如地在圖像、音頻、視頻各模態(tài)之間轉(zhuǎn)換,其能力也讓人刮目相看,例如根據(jù)一張地圖和表情符號(hào),就能設(shè)計(jì)出“猜國(guó)家”游戲;或者根據(jù)文字和圖像,猜出是哪部電影......

這還不夠,它還會(huì)教人念中文并區(qū)分四個(gè)聲調(diào),甚至能手把手教你做飯,有種上班是老師,下班秒變“小廚師”的感覺(jué),任誰(shuí)看了不直呼一句“厲害”!

難怪谷歌官方稱(chēng),Gemini是谷歌迄今為止“最大、最全能的AI模型”,它能夠進(jìn)行更復(fù)雜的推理,理解更加細(xì)微的信息,甚至像人一樣理解周?chē)氖澜纭Q句話說(shuō),它比之前任何技術(shù)都要牛!廢話不多說(shuō),下面我們就來(lái)看看,這個(gè)AI大模型有多厲害。

長(zhǎng)話短說(shuō),谷歌將Gemini定義為一款“原生多模態(tài)”模型!直白點(diǎn)解釋就是,Gemini一出廠就是“全科發(fā)展”,多種感官在模型內(nèi)統(tǒng)一學(xué)習(xí),而不是單獨(dú)學(xué)習(xí)再拼接到一起。

這里拿出OpenAI做典型,OpenAI的GPT-3.5一開(kāi)始是純文字大語(yǔ)言模型,直到GPT-4才安排了視覺(jué)等多模態(tài)能力,這種組裝拼接吧,就好比先學(xué)了語(yǔ)文再學(xué)數(shù)學(xué),極大可能帶來(lái)“偏科”問(wèn)題。

但全面發(fā)展的Gemini就不同,它從第一天起就設(shè)計(jì)成原生多模態(tài)結(jié)構(gòu),相當(dāng)于“所有科目一起學(xué)”,用谷歌的話講,它能無(wú)縫理解、操作不同類(lèi)型的信息,包括文本、代碼、音頻、圖像和視頻等,不需要額外轉(zhuǎn)換,各種模態(tài)的性能也更為平衡。

這里再舉個(gè)簡(jiǎn)單的例子:同樣是要理解圖像信息,像GPT-4這樣的非原生多模態(tài)結(jié)構(gòu)模型,需要先借助OCR(光學(xué)字符識(shí)別技術(shù))先“認(rèn)出來(lái)”圖里是什么——轉(zhuǎn)成文本,再放到語(yǔ)言模型中進(jìn)行語(yǔ)義理解。而Gemini能基于圖像馬上進(jìn)行理解,這種端到端的理解,不會(huì)讓信息在“轉(zhuǎn)錄”過(guò)程中丟失。

這樣一對(duì)比,想必大家就都懂了。

看來(lái),谷歌稱(chēng)Gemini超越了GPT-4,還真不是瞎吹牛!值得一提的是,谷歌這次一口氣提供了Gemini的三個(gè)尺寸模型:Gemini Ultra、Gemini Pro、Gemini Nano ,并分別對(duì)其進(jìn)行了優(yōu)化。

其中,Gemini Ultra版本功能最強(qiáng)大,能夠完成高度復(fù)雜的任務(wù),主要面向數(shù)據(jù)中心和企業(yè)級(jí)應(yīng)用;Gemini Pro則是性能最好的模型,可以執(zhí)行多種任務(wù),將通過(guò)谷歌的類(lèi)ChatGPT聊天機(jī)器人Bard,為眾多谷歌AI服務(wù)提供支持,加持谷歌的Gmail、Maps Docs和YouTube等服務(wù)。

最后就是Gemini Nano,這是最高效的模型,用于設(shè)備端任務(wù),可以在Android/ target=_blank class=infotextkey>安卓設(shè)備上本地和離線運(yùn)行。按照谷歌所說(shuō),該模型將首次內(nèi)置于谷歌手機(jī)Pixel 8 Pro上,支持錄音自動(dòng)摘要、鍵盤(pán)智能回復(fù)兩項(xiàng)功能,未來(lái)預(yù)計(jì)將更多功能置于安卓手機(jī)離線運(yùn)行。

鍵盤(pán)自動(dòng)生成回復(fù)語(yǔ)▲

整體來(lái)看,Gemini的多樣化設(shè)計(jì),使其能夠在各種設(shè)備上運(yùn)行,從手機(jī)到大型數(shù)據(jù)中心均適用,其優(yōu)勢(shì)顯而易見(jiàn)。話雖這么說(shuō),但紙上談兵可沒(méi)有信服力!

既然是被拿來(lái)“硬剛”GPT-4的模型,Gemini當(dāng)然少不了經(jīng)歷一番測(cè)試。

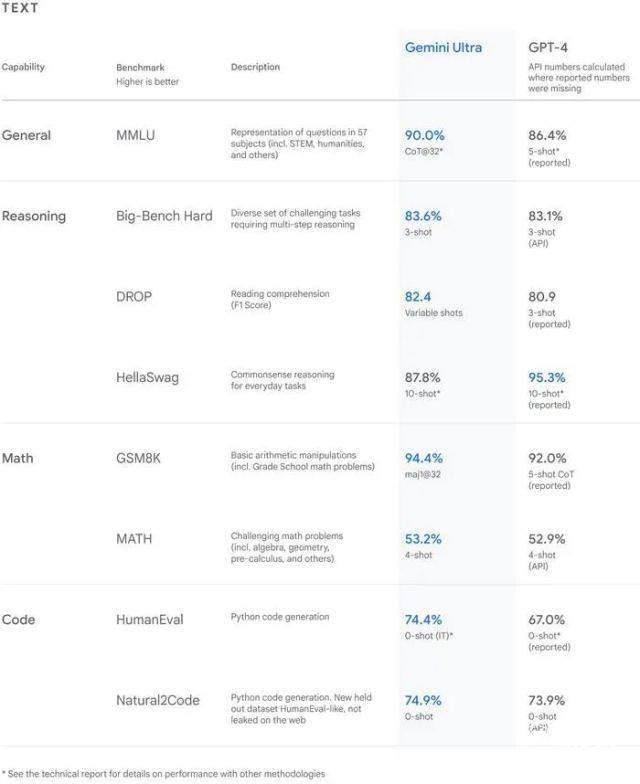

根據(jù)內(nèi)部消息,在推出Gemini之前,谷歌就對(duì)該模型進(jìn)行過(guò)一系列標(biāo)準(zhǔn)測(cè)試。結(jié)果顯示,性能上,Gemini訓(xùn)練所用的算力達(dá)到GPT-4的五倍,非常出色。其中,特別是在語(yǔ)言理解、推理、數(shù)學(xué)和編程測(cè)試中表現(xiàn)更佳。尤其是Gemini Ultra,在32個(gè)常用的學(xué)術(shù)基準(zhǔn)的30個(gè)上,已經(jīng)超越GPT-4。

并且Gemini Ultra在大規(guī)模多任務(wù)語(yǔ)言理解任務(wù)上,得分高達(dá)90.0%,是首個(gè)超越人類(lèi)專(zhuān)家的模型。

谷歌DeepMind CEO Demis Hassabis表示:“這是我們目前規(guī)模最大,性能最強(qiáng)的大模型,Gemini可以像我們一樣,理解我們周?chē)氖澜纭?rdquo;確實(shí),對(duì)于普通人而言,Gemini也大有用處,它可以同時(shí)識(shí)別和理解文本、圖像、音頻等各種形式的輸入內(nèi)容,因此能更好地理解細(xì)微的信息,回答與復(fù)雜主題相關(guān)的各類(lèi)問(wèn)題。

具體來(lái)看,對(duì)于圖像理解方面,根據(jù)谷歌在發(fā)布會(huì)放出的演示視頻,Gemini是玩“你畫(huà)我猜”的一把好手,不僅能準(zhǔn)確地描繪出測(cè)試者在紙上畫(huà)出的圖形,還能根據(jù)測(cè)試者畫(huà)出的輪廓,猜測(cè)出她繪制的是什么東西。

此外,它還能根據(jù)給出的文字和圖像,正確猜出所指電影的名字;又或者根據(jù)所給的服裝圖像,告訴你使用場(chǎng)景,甚至為這套搭配取名。

甚至它還能把圖像,轉(zhuǎn)變成代碼......

而在音頻理解上,Gemini也是一把好手,例如用戶上傳了一段非英語(yǔ)的音頻,然后又錄了一段英語(yǔ)的音頻來(lái)提問(wèn)。這聽(tīng)起來(lái)似乎有點(diǎn)麻煩,但Gemini卻可以輕松解決,它能同時(shí)處理兩段不同語(yǔ)言的音頻,并精準(zhǔn)輸出所需要的摘要內(nèi)容,讓人眼前一亮。

還沒(méi)完!Gemini還能根據(jù)指示,教工作人員“鴨子”的普通話發(fā)音,并解釋了漢語(yǔ)聲調(diào),點(diǎn)個(gè)贊!

更厲害的是,它還能教你做飯,例如煎個(gè)蛋?你可以用語(yǔ)音問(wèn)Gemini,還可以把手頭有的食材拍個(gè)照片發(fā)過(guò)去,然后Gemini就會(huì)結(jié)合配圖中的食材,及所發(fā)送的音頻需求,來(lái)一步步教你怎么做出完美的煎蛋。沒(méi)想到,有一天AI也能指導(dǎo)做飯,各位不會(huì)做飯星人有救了。

重點(diǎn)來(lái)了,Gemini理解文本的能力也不容小覷,它尤其擅長(zhǎng)解釋數(shù)學(xué)和物理等復(fù)雜科目中的推理。對(duì)于很多家長(zhǎng)來(lái)說(shuō),輔導(dǎo)孩子作業(yè)也是下班后“必不可少的工作”,但有時(shí)一些題目自己也不會(huì),或者因?yàn)橐恍﹦e的事,沒(méi)時(shí)間輔導(dǎo)孩子,該怎么辦呢?答案很簡(jiǎn)單,拍張圖交給Gemini就完事了。

它在給出正確答案的基礎(chǔ)上,還能針對(duì)解答過(guò)程中孩子不懂的步驟給出具體解釋?zhuān)踔了€可以指出孩子解答過(guò)程中具體出錯(cuò)的點(diǎn)。最后,你還可以直接讓Gemini輸出一個(gè)和出錯(cuò)類(lèi)型相似的題目,讓孩子再鞏固一下知識(shí)點(diǎn)。

其它方面,Gemini在辨認(rèn)環(huán)境、物體等場(chǎng)景,也不在話下。從谷歌演示來(lái)看,給它一張充滿陽(yáng)光的房間照片,它就能推理出來(lái)這個(gè)房間是朝南朝北,甚至告訴你房間里的植物應(yīng)該要怎么照顧。整個(gè)交流過(guò)程十分順暢,可見(jiàn)Gemini在多語(yǔ)言環(huán)境下表現(xiàn)出眾,完全不亞于GPT-4。

官方介紹,在Gemini的三個(gè)尺寸模型中,Gemini Pro已率先被用在谷歌聊天機(jī)器Bard的升級(jí)上。經(jīng)過(guò)谷歌測(cè)試后,Gemini Pro的表現(xiàn)要優(yōu)于GPT-3.5。

而為了進(jìn)一步展現(xiàn)升級(jí)后的Bard有多強(qiáng),谷歌還請(qǐng)了油管教育博主Mark Rober,全程使用Bard作為輔助工具,從零開(kāi)始畫(huà)圖紙,最后真的造出了一架巨大的紙飛機(jī)。

說(shuō)了這么多,其實(shí)無(wú)論是指導(dǎo)做飯,還是輔助造紙飛機(jī),都直觀說(shuō)明了,Gemini確實(shí)給普通大眾的生活,帶來(lái)了一定幫助,讓AI真正融入日常。

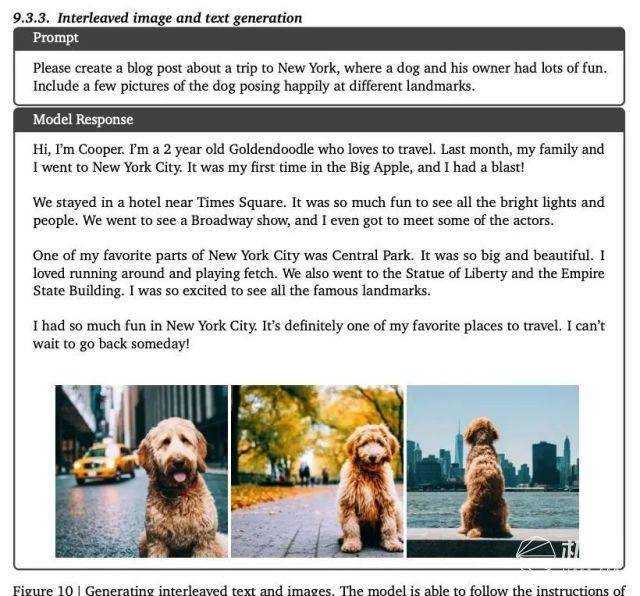

當(dāng)然,除了上面說(shuō)到的這些之外,谷歌還展示了Gemini的很多能力,例如讀柱狀圖,生成表格;或者直接生成圖文并茂的博客;以及展示圖形邏輯的推理,還有更為復(fù)雜的編程等等,這些都很好說(shuō)明了Gemini確實(shí)很聰明,智慧。

說(shuō)了這么多,總之從谷歌公布的一系列參數(shù)和操作展示來(lái)看,Gemini的“AI能力”有目共睹,確實(shí)越來(lái)越像一位真正的“人類(lèi)助手”!

現(xiàn)如今,人工智能迎來(lái)發(fā)展浪潮,對(duì)于谷歌而言,在AI即使早在AI領(lǐng)域深耕多年,擁有優(yōu)質(zhì)人才和深厚技術(shù)積累,卻被OpenAI搶了先,以至于后面不得不奮力追趕。

細(xì)數(shù)下來(lái),今年3月OpenAI發(fā)布GPT-4,隨后谷歌搞了一款Bard的聊天機(jī)器人,但可惜這款對(duì)標(biāo)ChatGPT的機(jī)器人并沒(méi)有獲得很大的市場(chǎng)聲量。后面的故事也不少,谷歌連續(xù)官宣戰(zhàn)略合作、緊急發(fā)布多個(gè)AI工具等等,這些大動(dòng)作,無(wú)疑都表明了谷歌在強(qiáng)烈反擊。

直到“谷歌大腦”與Alphabet旗下的人工智能實(shí)驗(yàn)室DeepMind合并后,數(shù)百名AI精兵瘋狂沖刺,才有了Gemini的誕生。現(xiàn)在憑借Gemini的強(qiáng)大實(shí)力,谷歌終于揚(yáng)眉吐氣,據(jù)說(shuō)Gemini官宣發(fā)布后,不少OpenAI的研究員也都發(fā)文祝賀谷歌。

而縱觀當(dāng)下整個(gè)AI浪潮發(fā)展史,Gemini的發(fā)布無(wú)疑是AI界又一個(gè)里程碑,這意味著AI大模型浪潮進(jìn)入到一個(gè)全新階段,比起大語(yǔ)言模型,這種多模態(tài)模型的運(yùn)作模式,才是人類(lèi)最自然的和世界交互的方式。

但話說(shuō)回來(lái),多模態(tài)領(lǐng)域還在技術(shù)探索初期,Gemini的發(fā)布也只是掀起了其中一角,但這也將直接導(dǎo)致全球的AI大模型競(jìng)賽進(jìn)入新一輪競(jìng)爭(zhēng),那么就期待下谷歌或OpenAI,會(huì)不會(huì)再掀起巨大水花吧。

本文由極果用戶極果媒體原創(chuàng)